Utiliser des LLM distants

ChatGPT

1. Introduction

a. Usage

Utiliser un LLM local est une solution séduisante pour la confidentialité des données, la facilité d’accès et la gratuité. Mais cela peut nécessiter le passage à une machine suffisamment équipée avec un NPU ou GPU et disposant de RAM adéquates pour contenir le modèle souhaité. D’où une autre alternative qui consiste à interagir par l’API vers les grandes plateformes. Cela donne donc accès à une puissance maximale (précision de la réponse, haute disponibilité et répartition de charges), par contre cet accès sera généralement payant à la requête et réponse (en nombre de tokens en entrée et en sortie).

ChatGPT est un LLM particulièrement utilisé, développé en 2022 par OpenAI, il devient surtout connu avec sa version GPT-4 en 2023. Il connaît depuis un succès fulgurant. Des analyses de trafic indiquent environ 120 millions d’utilisateurs actifs chaque jour à l’écriture de cet ouvrage.

Mistral AI avec « Le Chat », malgré un fort poids côté entreprises, afficherait environ 1 million d’utilisateurs quotidien.

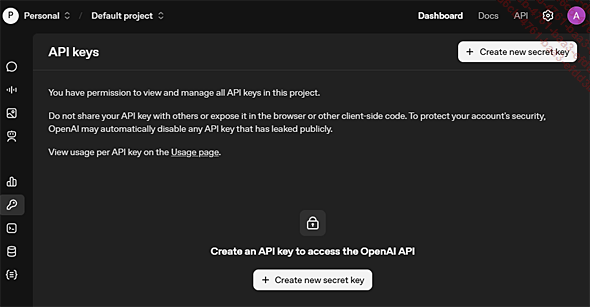

b. Obtenir une clé d’accès

ChatGPT n’est pas qu’une interface de saisie de prompt, c’est aussi une API d’accès en JavaScript. Pour commencer, vous devez vous connecter avec votre compte sur la plateforme API d’OpenAI afin de générer une clé d’accès à l’API (https://platform.openai.com/api-keys).

Figure 1 - Création d’une clé d’accès

Une fois le bouton Create new secret key activé, vous pouvez ensuite créer une clé secrète en spécifiant éventuellement un nom et un projet. Une boîte de dialogue apparaît ensuite avec un identifiant pour votre clé qu’il vous faut conserver. Vous pouvez créer plusieurs clés.

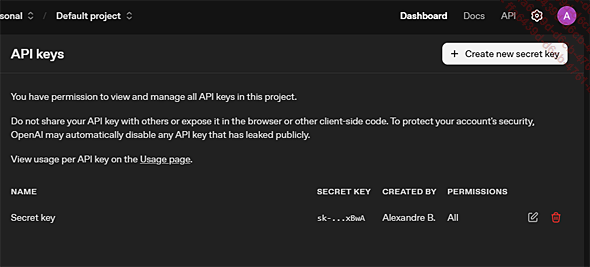

Un tableau vous rappelle toutes les clés que vous avez générées et le type de permission associé (par défaut All).

Figure 2 - Tableau de vos clés d’accès

La clé que vous avez obtenue ne doit pas être visible, par exemple...

Mistral AI

1. Introduction

a. Société

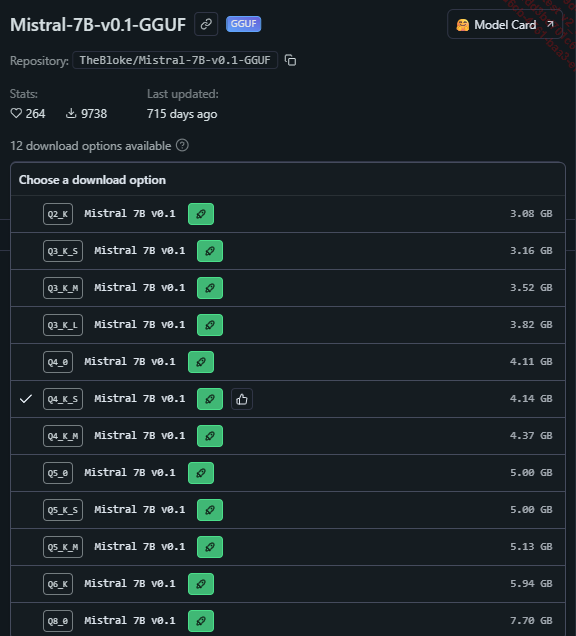

Mistral AI a été fondée en 2023 par trois experts français en IA (Arthur Mensch, Guillaume Lample, Timothée Lacroix). L’objectif était de créer une alternative à la domination américaine en s’appuyant sur un mixte entre solutions open source et propriétaire. Mistral AI vous met à disposition de nombreux modèles (https://huggingface.co/mistralai) que vous pouvez déjà utiliser en local généralement entre 3 et 24 milliards de paramètres (hors quantification).

Par exemple, le modèle local Mistral-7B est quantifié entre 2 et 8 bits (voir figure ci-dessous), ce qui borne les besoins mémoire entre 3 et 7 Go, donc idéal pour des configurations plus légères.

Figure 4 - Différentes quantifications par modèle local

b. Tarifications

Vous pouvez obtenir les tarifications concernant l’usage de l’API en ligne avec la page https://mistral.ai/fr/pricing.

Le prix est exprimé à chaque fois en million de tokens, un token peut correspondre environ à 4 caractères. Si nous avons par exemple la requête "Comment trier un tableau en JavaScript ?", cela fait environ 10 tokens. Si la réponse fait le double, nous aurons environ 20 tokens.

Prix de la requête sur le modèle Mistral Small 3.2 (mistral-small-latest).

Entrée : 0,1$ * ( 10 / 1000 000 ) = 0,000001

Sortie : 0,3$ * ( 20 / 1 000 000 ) = 0.000006

Total = 0.000007$

2. API REST

a. Clé pour l’API

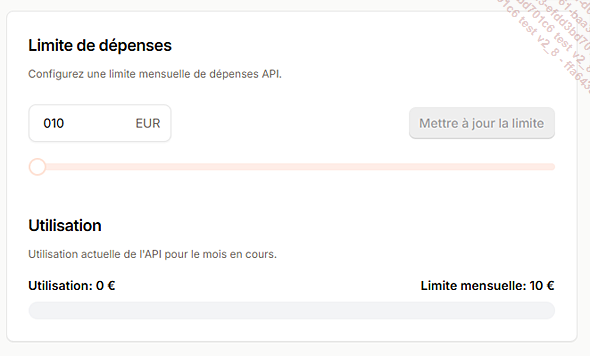

Avant de commencer à pouvoir interroger le modèle en ligne, il nous faut obtenir une clé API, cela passe par la console en ligne (https://console.mistral.ai). Vous aurez alors à choisir un plan d’usage, soit de test avec un accès gratuit (Experiment), soit de paiement à l’usage (Scale). Dans ce dernier cas, vous pourrez aussi définir une date d’expiration de votre clé.

Si vous êtes en accès à l’usage, vous pourrez définir une limite de vos dépenses mensuelles (voir figure ci-dessous) avec un minimum à 5 €.

Figure 5 - Limitation des dépenses mensuelles

b. Liste des modèles

L’accès se fait toujours par l’URL de base...

Editions ENI Livres | Vidéos | e-Formations

Editions ENI Livres | Vidéos | e-Formations